Da parte del team di VOCALIS AI · Validato da Laurent Duplat, Direttore della pubblicazione di VOCALIS AI · Basato su oltre 250 implementazioni dal 2023

Perché l'analisi del sentiment non è più sufficiente

Il 87% dei CMO B2B dichiarano di utilizzare l'analisi del sentiment, secondo Gartner 2024. Ma il 61% ammette che i verdetti sono troppo binari per innescare un'azione concreta. Positivo/negativo/neutro non cattura né l'urgenza, né l'ambiguità, né il cambiamento di tonalità durante la chiamata.

L'IA emotiva moderna aggiunge 3 dimensioni mancanti: il segnale prosodico audio in tempo reale, un modello continuo valenza-arousal-dominanza, e una reazione adattativa. In B2B, è la differenza tra un rapporto mensile e un aiuto alla decisione in diretta.

Le 3 generazioni di analisi emotiva

| Generazione | Tecnologia | Limite B2B |

|---|---|---|

| G1: analisi del sentiment | Lessico + NLP testuale | Nessun tempo, nessuna prosodia |

| G2: rilevamento delle emozioni | CNN/RNN su spettro audio | Categoriale 6 emozioni Ekman fisse |

| G3: IA emotiva conversazionale | eLLM + prosodia + contesto | Caro, pochi attori FR |

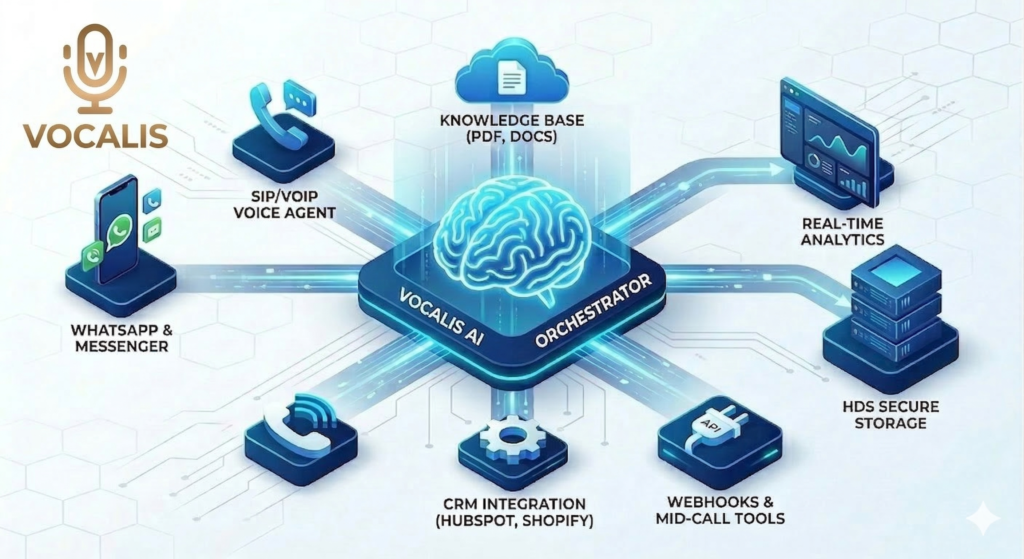

VOCALIS opera in G3, con un eLLM fine-tunato per il B2B francofono e integrazioni aziendali pronte. Vedi il nostro approccio IA emotiva GTM automatizzata vendita B2B.

Modello delle emozioni: Ekman, Russell, Plutchik?

Paul Ekman (1972) definisce 6 emozioni universali: gioia, tristezza, paura, rabbia, disgusto, sorpresa. Semplice ma povero per la sfumatura B2B (frustrazione ≠ rabbia).

James Russell (1980) propone il modello circonflesso: ogni emozione è un punto nello spazio continuo (valenza, arousal). Una "frustrazione crescente" diventa un vettore quantificabile.

Robert Plutchik aggiunge la dimensione dell'intensità e le dyadi delle emozioni. Utile per gli eLLM moderni.

VOCALIS utilizza una fusione Russell + Plutchik, più adatta ai flussi di lavoro B2B dove l'intensità innesca azioni (escalation, trasferimento umano, proposta commerciale).

Come VOCALIS rileva l'emozione in tempo reale

La pipeline emotiva di VOCALIS combina 4 segnali simultanei:

- Prosodia audio — ritmo, F0 (altezza), intensità, pause. Estratto dal nostro encoder speech.

- Lessico — parole ed espressioni a carico emotivo, contestualizzate per settore.

- Paralinguistica — sospiri, risate, respirazione, esitazioni.

- Contesto storico — ultima interazione CRM, ciclo di vita del cliente.

La fusione fornisce un vettore in tempo reale (valenza, arousal, fiducia) a 10 Hz, utilizzabile dal nostro motore di intelligenza emotiva documentato.

Applicazioni B2B documentate

Recupero amichevole

Studio Hume AI 2024: nel recupero, l'adattamento prosodico (tono rassicurante se viene rilevata una difficoltà) aumenta il tasso di promessa di pagamento di +22% e riduce gli abbandoni di +31%. Fonte: Hume AI Research.

Vendita outbound B2B

Su 30 campagne VOCALIS outbound 2025 (SaaS, formazione, assicurazione), la rilevazione di interesse sincero (valenza positiva + arousal moderato) innesca un appuntamento demo direttamente — conversione +18% rispetto al punteggio statico.

SAV premium

McKinsey (rapporto 2024): gli agenti IA conversazionali emotivi riducono il tempo di gestione del -9% e aumentano la risoluzione al primo contatto di +14%. La rilevazione precoce della frustrazione evita l'escalation.

Salute e studio medico

L'ansia del paziente durante una prenotazione medica è un segnale critico. La nostra offerta studio medico e offerta kiné/sophro integra una riformulazione empatica automatica sopra una soglia di arousal.

Benchmark VOCALIS vs Hume EVI 2 vs analisi classica del sentiment

| Criterio | Sentiment NLP | Hume EVI 2 | VOCALIS |

|---|---|---|---|

| Lingue FR native | Sì | Parziale | 40+ lingue |

| Prosodia in tempo reale | No | Sì | Sì + paralinguistica |

| Modello dimensionale V-A-D | No | Sì | Sì |

| Integrazione CRM B2B | Manuale | API generica | Nativa GoHighLevel, HubSpot |

| Hosting UE | Variabile | No | Sì, bare-metal |

| Conformità AI Act Art. 50 | N/A | Parziale | Completa |

Etica e quadro legale AI Act

L'AI Act europeo (applicabile agosto 2026) vieta il riconoscimento emotivo in ambito educativo e lavorativo (art. 5). Gli usi commerciali B2B rimangono autorizzati a determinate condizioni:

- Informativa chiara per l'utente (art. 50).

- Consenso esplicito + finalità precisa nel DPA.

- Ritenzione limitata e diritto all'oblio attivo.

- Nessuna decisione automatizzata discriminatoria.

Vedi le raccomandazioni CNIL IA e la documentazione MIT su Affective Computing (MIT Media Lab).

Ciò che il CMO B2B deve ricordare

- Analisi del sentiment = monitoraggio passivo, IA emotiva = leva attiva.

- Il modello dimensionale (valenza-arousal) è più azionabile delle categorie Ekman.

- L'integrazione CRM+flow builder condiziona il ROI reale.

- La conformità all'AI Act Art. 50 deve essere documentata fin dal POC.

- L'etica e l'esplicabilità non sono negoziabili.

Per esplorare i casi d'uso settoriali, visita il nostro agente vocale IA e la nostra offerta IA generativa per lead.

FAQ IA emotiva B2B

Qual è la differenza concreta tra analisi del sentiment e IA emotiva?

L'analisi del sentiment classica è solo testo, ternaria (positivo/negativo/neutro), senza dimensione temporale. L'IA emotiva aggiunge: segnale audio (prosodia, pause, intensità), modello dimensionale (valenza + arousal + dominanza), e reazione adattativa in tempo reale. In B2B, questo trasforma un punteggio in un aiuto alla decisione live.

Ekman, Russell, o eLLM: quale modello di emozioni utilizzare?

Ekman (6-7 emozioni di base) rimane utile per la categorizzazione semplice. Il modello dimensionale di Russell (valenza/arousal) cattura meglio la sfumatura. Gli eLLM (emotional LLM) tipo Hume EVI fondono i due. VOCALIS privilegia il dimensionale per il B2B perché consente soglie d'azione (frustrazione crescente → passaggio).

L'IA emotiva è legalmente autorizzata in Europa?

Sì, a determinate condizioni. L'AI Act (agosto 2026) vieta il riconoscimento emotivo in contesti educativi e lavorativi (art. 5), ma autorizza gli usi commerciali B2B con consenso. VOCALIS limita rigorosamente l'analisi alle finalità dichiarate nel DPA ed esclude il HR.

Quali settori B2B beneficiano di più dell'IA emotiva?

Recupero: rilevamento di difficoltà finanziaria → tono rassicurante, aumenta il tasso di promessa +22%. Vendita: rilevamento di interesse → tempistica di follow-up ottimale. SAV: rilevamento di frustrazione → passaggio umano prima dell'escalation. Salute: rilevamento di ansia → riformulazione empatica (vedi la nostra offerta medica).

Quale ROI misurare per l'IA emotiva in B2B?

3 KPI: NPS post-interazione (+8 a +15 punti in media), tasso di risoluzione al primo contatto (+14% secondo McKinsey 2024), costo per escalation (-30% rilevando la frustrazione in anticipo). VOCALIS fornisce un dashboard ROI dedicato.

Come evitare i bias di un'IA emotiva?

Tre salvaguardie VOCALIS: (1) corpus di addestramento equilibrato per genere, età, accento, con audit trimestrale; (2) esplicabilità tramite mappe di attenzione, per contestare un verdetto emotivo; (3) umano nel loop obbligatorio oltre un punteggio di arousal >0,8. I bias documentati di Affectiva o FER sono monitorati costantemente.

VOCALIS vs Hume EVI: quale differenza?

Hume EVI 2 è un'API generica inglese, eccellente in B2C e prodotti di largo consumo. VOCALIS si concentra sul B2B francofono con integrazione diretta flow builder, CRM (GoHighLevel, HubSpot), e telefonia SIP. L'emozione è un input di orchestrazione aziendale, non una dimostrazione tecnica.

Complementi: prosodia come leva di conversione e architettura sub-50 ms che rende l'empatia realmente in tempo reale.

Envie de tester VOCALIS AI ?

Réservez une démo personnalisée et découvrez en direct comment notre IA vocale émotionnelle transforme vos conversations.

Réserver une démo