Par l'équipe VOCALIS AI · Validé par Laurent Duplat, Directeur de la publication VOCALIS AI · Basé sur +250 déploiements depuis 2023

Pourquoi le sentiment analysis ne suffit plus

87 % des CMO B2B déclarent utiliser du sentiment analysis, selon Gartner 2024. Mais 61 % admettent que les verdicts sont trop binaires pour déclencher une action concrète. Positif/négatif/neutre ne capture ni l'urgence, ni l'ambiguïté, ni le retournement de tonalité en cours d'appel.

L'IA émotionnelle moderne ajoute 3 dimensions manquantes : le signal prosodique audio temps réel, un modèle continu valence-arousal-dominance, et une réaction adaptative. En B2B, c'est la différence entre un rapport mensuel et une aide à la décision en direct.

Les 3 générations d'analyse émotionnelle

| Génération | Technologie | Limite B2B |

|---|---|---|

| G1 : sentiment analysis | Lexique + NLP texte | Pas de tempo, pas de prosodie |

| G2 : emotion detection | CNN/RNN sur spectre audio | Catégoriel 6 émotions Ekman figées |

| G3 : IA émotionnelle conversationnelle | eLLM + prosodie + contexte | Coûteux, peu d'acteurs FR |

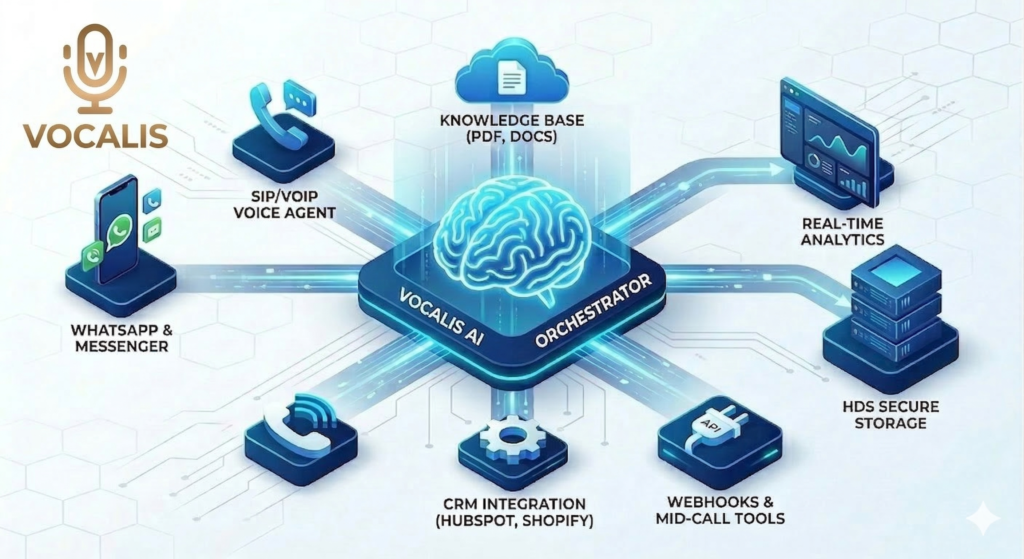

VOCALIS opère en G3, avec un eLLM fine-tuné pour le B2B francophone et des intégrations métier prêtes. Voir notre approche IA émotionnelle GTM automatisée vente B2B.

Modèle d'émotions : Ekman, Russell, Plutchik ?

Paul Ekman (1972) définit 6 émotions universelles : joie, tristesse, peur, colère, dégoût, surprise. Simple mais pauvre pour la nuance B2B (frustration ≠ colère).

James Russell (1980) propose le modèle circumplex : chaque émotion est un point dans l'espace continu (valence, arousal). Une "frustration croissante" devient un vecteur quantifiable.

Robert Plutchik ajoute la dimension d'intensité et les dyades d'émotions. Utile pour les eLLM modernes.

VOCALIS utilise une fusion Russell + Plutchik, plus adaptée aux workflows B2B où l'intensité déclenche des actions (escalade, transfert humain, proposition commerciale).

Comment VOCALIS détecte l'émotion en temps réel

La pipeline émotionnelle VOCALIS combine 4 signaux simultanés :

- Prosodie audio — rythme, F0 (hauteur), intensité, pauses. Extrait par notre encodeur speech.

- Lexique — mots et expressions à charge émotionnelle, contextualisés par secteur.

- Paralinguistique — soupirs, rires, respiration, hésitations.

- Contexte historique — dernière interaction CRM, cycle de vie client.

La fusion donne un vecteur temps réel (valence, arousal, confiance) à 10 Hz, exploitable par notre moteur d'intelligence émotionnelle documenté.

Applications B2B documentées

Recouvrement amiable

Étude Hume AI 2024 : en recouvrement, l'adaptation prosodique (ton apaisant si détresse détectée) augmente le taux de promesse de paiement de +22 % et réduit les abandons de +31 %. Source : Hume AI Research.

Vente sortante B2B

Sur 30 campagnes VOCALIS outbound 2025 (SaaS, formation, assurance), la détection d'intérêt sincère (valence positive + arousal modéré) déclenche un créneau démo directement — conversion +18 % vs scoring statique.

SAV premium

McKinsey (rapport 2024) : les agents IA conversationnels émotionnels réduisent le handle time de -9 % et augmentent la résolution au 1er contact de +14 %. La détection précoce de frustration évite l'escalade.

Santé et cabinet médical

L'anxiété patient lors d'une prise de RDV médicale est un signal critique. Notre offre cabinet médical et offre kiné/sophro intègre une reformulation empathique automatique au-dessus d'un seuil arousal.

Benchmark VOCALIS vs Hume EVI 2 vs sentiment classique

| Critère | Sentiment NLP | Hume EVI 2 | VOCALIS |

|---|---|---|---|

| Langues FR natif | Oui | Partiel | 40+ langues |

| Prosodie temps réel | Non | Oui | Oui + paralinguistique |

| Modèle dimensionnel V-A-D | Non | Oui | Oui |

| Intégration CRM B2B | Manuelle | API générique | Natif GoHighLevel, HubSpot |

| Hébergement UE | Variable | Non | Oui, bare-metal |

| Conformité AI Act Art. 50 | N/A | Partielle | Complète |

Éthique et cadre légal AI Act

L'AI Act européen (applicable août 2026) interdit la reconnaissance émotionnelle en milieu éducatif et workplace (art. 5). Les usages B2B commerciaux restent autorisés sous conditions :

- Information claire de l'utilisateur (art. 50).

- Consentement explicite + finalité précise au DPA.

- Rétention limitée et droit à l'effacement actif.

- Pas de décision automatisée discriminatoire.

Voir les recommandations CNIL IA et la documentation MIT sur Affective Computing (MIT Media Lab).

Ce que le CMO B2B doit retenir

- Sentiment analysis = monitoring passif, IA émotionnelle = levier actif.

- Le modèle dimensionnel (valence-arousal) est plus actionnable que les catégories Ekman.

- L'intégration CRM+flow builder conditionne le ROI réel.

- La conformité AI Act Art. 50 doit être documentée dès le POC.

- L'éthique et l'explicabilité ne sont pas négociables.

Pour explorer les cas d'usage sectoriels, parcourez notre agent vocal IA et notre offre IA générative pour lead.

FAQ IA émotionnelle B2B

Quelle est la différence concrète entre sentiment analysis et IA émotionnelle ?

Le sentiment analysis classique est texte-only, ternaire (positif/négatif/neutre), sans dimension temporelle. L'IA émotionnelle ajoute : signal audio (prosodie, pauses, intensité), modèle dimensionnel (valence + arousal + dominance), et réaction adaptative en temps réel. En B2B, cela transforme un scoring en aide à la décision live.

Ekman, Russell, ou eLLM : quel modèle d'émotions utiliser ?

Ekman (6-7 émotions de base) reste utile pour le catégoriel simple. Le modèle dimensionnel de Russell (valence/arousal) capture mieux la nuance. Les eLLM (emotional LLM) type Hume EVI fusionnent les deux. VOCALIS privilégie le dimensionnel pour le B2B car il permet des seuils d'action (frustration croissante → handover).

L'IA émotionnelle est-elle légalement autorisée en Europe ?

Oui, sous conditions. L'AI Act (août 2026) interdit la reconnaissance émotionnelle en contextes éducatif et workplace (art. 5), mais autorise les usages B2B commerciaux avec consentement. VOCALIS limite strictement l'analyse aux finalités déclarées dans le DPA et exclut le HR.

Quels secteurs B2B bénéficient le plus de l'IA émotionnelle ?

Recouvrement : détection détresse financière → ton apaisant, augmente taux promesse +22 %. Vente : détection intérêt → relance timing optimal. SAV : détection frustration → handover humain avant escalade. Santé : détection anxiété → reformulation empathique (voir notre offre médicale).

Quel ROI mesurer pour l'IA émotionnelle en B2B ?

3 KPIs : NPS post-interaction (+8 à +15 pts en moyenne), taux de résolution au premier contact (+14 % selon McKinsey 2024), coût par escalade (-30 % en détectant la frustration en amont). VOCALIS fournit un dashboard ROI dédié.

Comment éviter les biais d'une IA émotionnelle ?

Trois garde-fous VOCALIS : (1) corpus d'entraînement équilibré en genre, âge, accent, avec audit trimestriel ; (2) explicabilité via attention maps, pour contester un verdict émotionnel ; (3) humain dans la boucle obligatoire au-delà d'un score arousal >0,8. Les biais documentés d'Affectiva ou FER sont surveillés en permanence.

VOCALIS vs Hume EVI : quelle différence ?

Hume EVI 2 est une API générique anglaise, excellente en B2C et produit grand public. VOCALIS cible le B2B francophone avec intégration directe flow builder, CRM (GoHighLevel, HubSpot), et SIP téléphonie. L'émotion est un input d'orchestration business, pas une démonstration technique.

Compléments : prosodie comme levier de conversion et architecture sub-50 ms qui rend l'empathie réellement temps réel.

Envie de tester VOCALIS AI ?

Réservez une démo personnalisée et découvrez en direct comment notre IA vocale émotionnelle transforme vos conversations.

Réserver une démo